Pemerintah Amerika Serikat sedang membuat panduan utama untuk implementasi kecerdasan buatan (AI) generatif yang aman. Institut Standar dan Teknologi Nasional (NIST) Departemen Perdagangan mengatakan bahwa mereka sedang melakukan konsultasi publik. Pengujian akan dilakukan pada tanggal 2 Februari 2024 untuk memastikan keamanan sistem AI.

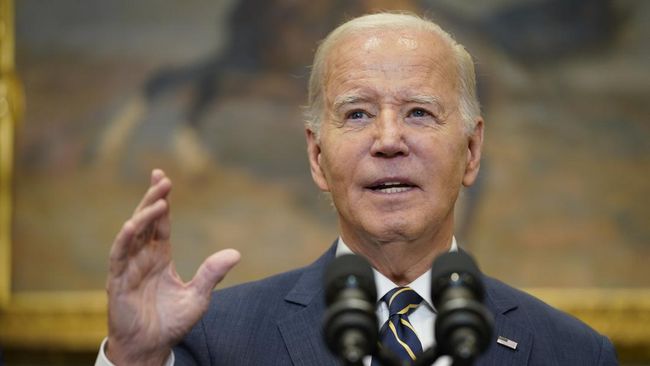

Menteri Perdagangan Gina Raimondo mengatakan bahwa upaya ini dipicu oleh perintah eksekutif Presiden Joe Biden pada Oktober lalu. Presiden Biden ingin mengembangkan standar industri terkait keselamatan, keamanan, dan kepercayaan AI.

Pengembangan panduan ini dimaksudkan agar Amerika Serikat terus memimpin dunia dalam pengembangan dan penggunaan AI yang bertanggung jawab, di tengah kemajuan teknologi yang pesat.

NIST sedang mengembangkan pedoman untuk mengevaluasi AI, memfasilitasi pengembangan standar, dan menyediakan lingkungan pengujian untuk mengevaluasi sistem AI. Badan ini meminta masukan dari perusahaan AI dan masyarakat mengenai manajemen risiko AI generatif dan mengurangi risiko misinformasi yang dihasilkan AI.

Pengembangan AI generatif yang dapat membuat teks, foto, dan video sebagai respons terhadap permintaan terbuka, telah memicu ketakutan di masyarakat. Presiden Biden juga memerintahkan lembaga-lembaga untuk menetapkan standar pengujian dan mengatasi risiko terkait keamanan AI.

NIST saat ini sedang berupaya menetapkan pedoman untuk pengujian, termasuk penggunaan “tim merah” sebagai alat utama untuk penilaian dan manajemen risiko AI serta menetapkan praktik terbaik untuk melakukannya. Tim merah ini telah digunakan dalam keamanan siber selama bertahun-tahun untuk mengidentifikasi risiko baru terkait dengan keamanan.

Pada bulan Agustus, “tim merah” mendapat penilaian publik AS pertama yang diadakan pada konferensi keamanan siber besar dan diselenggarakan oleh AI Village, SeedAI, Humane Intelligence. Acara tersebut menunjukkan bagaimana kerja sama eksternal dapat menjadi alat yang efektif untuk mengidentifikasi risiko baru AI.